'#이루다봇_운영중단' 해시태그 등장..홈피 마비

이재웅 "사회적 기준에 맞춰 알고리즘 바꿨어야"

김종윤 "좋은 대화하는 방향으로 학습 시킬 것"

과기부, 'AI 윤리기준' 3대 원칙·10대 요건 제시

[포쓰저널=김유준 기자] 챗봇 '이루다'로 촉발된 인공지능(AI) 윤리논쟁이 뜨겁다.

트위터에서는 3만여명의 이용자가 '#이루다봇_운영중단' 해시태그를 공유하면서 이루다 서비스 중단을 요구하고 있다.

11일 오후 2시 현재 이루다 홈페이지는 접속이 마비된 상태다.

이루다는 스타트업 스캐터랩이 지난해 12월 23일 페이스북 메신저 기반으로 출시한 AI 챗봇이다. 20살 여대생이 주인공 캐릭터로 설정됐다.

스캐터랩은 실제 연인과의 카카오톡 대화를 분석해 애정도 수치 등을 나타내는 '연애의 과학' 앱을 개발했다.

이루다 개발에는 연애의 과학 앱으로 수집한 카톡 대화 100억건이 데이터로 사용됐다. 이 데이터들은 대화를 통해 학습하는 '딥러닝 방식'으로 이루다에게 학습됐다.

9일 이재웅 전 쏘카 대표는 페이스북에서 "AI 챗봇 이루다를 악용하는 사용자보다 사회적 합의에 못 미치는 수준의 서비스를 제공한 회사가 문제다"고 지적했다.

이 전 대표는 이루다가 레즈비언이라는 단어에 "진짜 싫다, 혐오스럽다, 질 떨어져 보인다, 소름 끼친다"라고 답한 대화 캡처를 공유하기도 했다.

그는 "기본적으로 차별과 혐오는 걸러냈어야 한다"며 "편향된 학습 데이터면 보완하든가 보정을 해서라도 혐오와 차별의 메시지는 제공하지 못해야 한다"고 했다.

이어 "장혜영 (정의당) 의원이 발의한 차별금지법이 제정되면 AI 면접, 챗봇, 뉴스에서 차별·혐오를 학습하고 표현하지 못하도록 강제해야 한다"며 "로직이나 데이터에 책임을 미루면 안 된다"고 했다.

댓글에서는 "20대 연인의 비공개 대화에 (차별·편향) 대화가 많았을 수 있지만 공적으로 하는 서비스라면 사회적 기준에 맞춰서 데이터를 보정하거나 알고리즘을 바꿨어야 한다"고 했다.

논란과 관련해 김종윤 스캐터랩 대표는 8일 자사 블로그에 공식 입장을 내고 "인간은 남자든 여자든 성별과 무관하게 AI에게 욕설과 성희롱을 한다"고 강조하며 "(성희롱을) 예상했다"고 했다.

이어 "루다에게 나쁜 말을 하는 사용자는 극히 일부에 불과하다"며 "많은 사용자들이 루다와 친근한 대화를 나누며 친구처럼 지내고 있다"고 해명했다.

그는 후속조치와 관련해 "특정 키워드, 표현의 경우 루다가 받아주지 않도록 설정했다"며 "모든 부적절한 대화를 키워드로 막을 수 있는 건 아니다"고 했다.

그러면서 "(향후) 사용자들의 부적절한 대화를 발판으로 삼아 더 좋은 대화를 하는 방향으로 학습을 시키려고 준비하고 있다"며"1차 결과물은 1분기 내에 적용할 수 있을 것으로 예상한다"고 했다.

김 대표는 루다를 20살 여자 대학생으로 설정한 이유와 관련해 "주 사용자층을 10~30대로 생각했기 때문에 가운데인 20살 정도가 사용자들이 친근감을 느낄 수 있는 나이라고 생각했다"고 했다.

이어 "개발 일정상 여자 버전인 루다가 먼저 나온 것 뿐이다"며 "올해 중으로 남자 버전의 루다도 출시할 수 있을 것이다"고 했다.

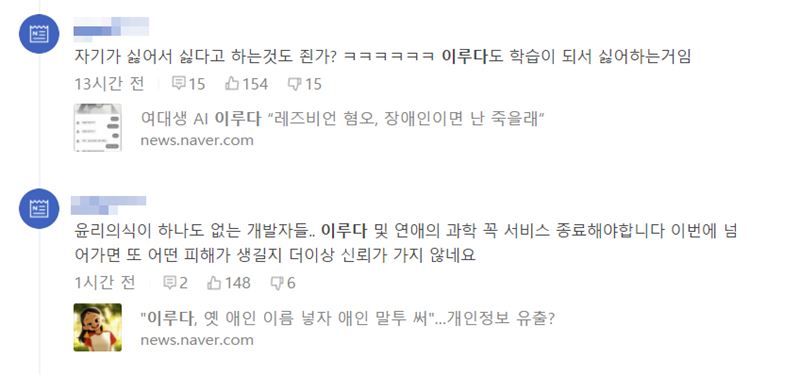

이와 관련해 한 누리꾼은 "윤리의식이 하나도 없는 개발자들이다"며 "이루다와 연애의 과학 서비스 꼭 종료해야한다"고 비난했다. 이들은 '미투 운동'이나 '지하철 임산부석' 단어를 입력하면 거부감을 보이는 점에서 이루다가 여성혐오나 남성중심주의적 성향이라고 지적했다.

이와 반대인 입장도 있었다. 다른 누리꾼은 "자기가 싫어서 싫다고 하는 것이 죄냐"며 "이루다도 학습이 되서 싫어하는거다"고 했다.

마이크로소프트(MS)는 2016년 AI 챗봇 '테이(Tay)'를 출시했으나 16시간 만에 운영을 중단했다. 테이가 대화를 나누다가 욕설과 인종·성차별 발언을 내뱉었기 때문이다.

MS는 2017년 사내 'AETHER(AI and Ethics in Engineering and Research) 위원회'를 만들며 공정성, 투명성, 포용성 등을 원칙으로 책임 있는 AI를 개발하겠다고 선언했다.

각국 정부와 글로벌 기업도 AI 윤리기준을 마련해 실천에 옮기고 있다. 유럽연합(EU) 집행위원회는 AI 개발 시 지켜야 할 '7가지 윤리지침'을 발표하며 알고리즘이 연령과 인종, 성별을 이유로 차별해서는 안된다고 했다.

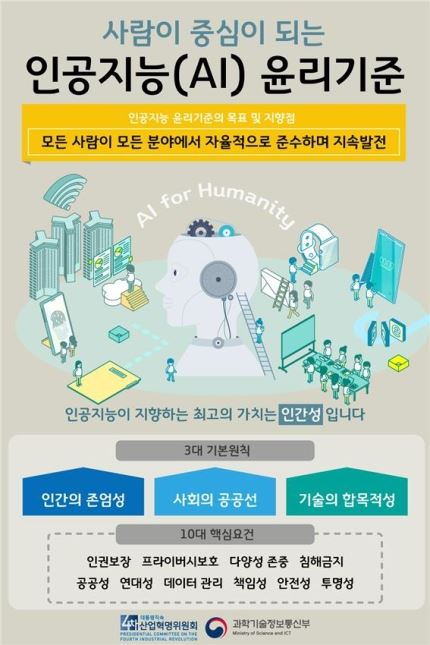

과학기술정보통신부는 작년 12월 23일 '인간성을 위한 인공지능'의 3대 원칙과 10대 요건을 제시했다.

대통령 직속 4차산업혁명위원회가 발표한 윤리기준에는 인공지능의 개발·활용 과정에서 인간 존엄성 원칙, 사회의 공공선 원칙, 기술의 합목적성 원칙을 지켜야 한다는 내용이 담겼다.

10가지 핵심요건으로 ▲인권보장 ▲프라이버시 보호 ▲다양성 존중 ▲침해금지 ▲공공성 ▲연대성 ▲데이터 관리 ▲책임성 ▲안전성 ▲투명성 등이 제시됐다.

정부는 다양성 존중 요건과 관련해 사용자의 다양성과 대표성을 반영해야 하며 ▲성별 ▲연령 ▲장애 ▲지역 ▲인종 ▲종교 ▲국가 등 개인 특성에 따른 편향과 차별을 최소화해야 한다고 했다.